En quelques semaines, un classement peut être totalement redistribué. C’est le constat que dresse la WebDev Arena en ce mois de mars 2026. L’arrivée d’une nouvelle génération de modèles suffit à rebattre les cartes et à reléguer les leaders du mois précédent. Tour d’horizon des modèles d’IA qui se distinguent dans les tâches de code et de développement web.

Anthropic domine la WebDev Arena avec Claude 4.6

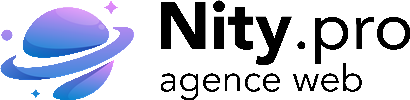

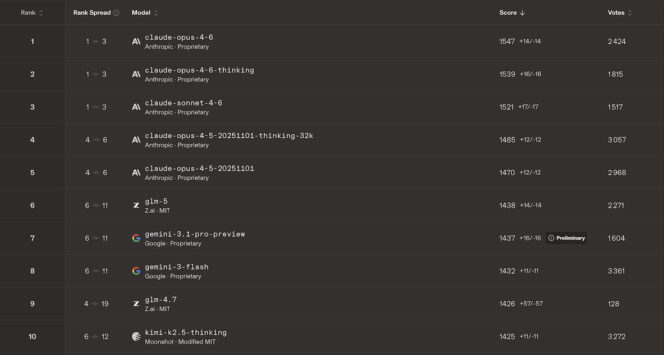

Le fait marquant de ce mois de mars 2026, c’est l’arrivée de la famille Claude 4.6 dans la WebDev Arena. Le nouveau modèle d’Anthropic s’impose immédiatement : Claude Opus 4.6 prend la première place du classement général, devant sa version Thinking et Claude Sonnet 4.6, qui complète le podium. Claude Opus 4.5 Thinking, leader du classement le mois dernier, glisse à la quatrième position. Anthropic verrouille ainsi les quatre premières places, une domination inédite sur ce benchmark.

Parallèlement, OpenAI accuse le coup. GPT-5.2 High, deuxième en février, recule à la cinquième place, à égalité de score avec Claude Opus 4.5 standard. Google, de son côté, fait entrer Gemini 3.1 Pro Preview à la 7e place, mais ce score reste préliminaire (nombre de votes encore limité). Ses modèles Gemini 3 Pro et Gemini 3 Flash complètent le top 10.

À noter : GLM-5, le modèle open source de Z.ai (lié à l’université Tsinghua), confirme sa montée en puissance en s’installant à la 8e place du classement, devant les deux modèles de Gemini 3 de Google.

Les 10 modèles d’IA les plus performants pour le code et le développement web en mars 2026 :

- Claude Opus 4.6 : 1560 (score Elo)

- Claude Opus 4.6 Thinking : 1553

- Claude Sonnet 4.6 : 1531

- Claude Opus 4.5 Thinking : 1499

- GPT-5.2 High : 1471

- Claude Opus 4.5 : 1471

- Gemini 3.1 Pro Preview : 1461

- GLM-5 (Z.ai) : 1451

- Gemini 3 Pro : 1443

- Gemini 3 Flash : 1441

Découvrir le classement complet

Les classements HTML et React confirment la tendance

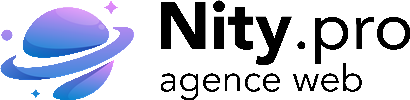

La WebDev Arena propose également des classements par technologie. En HTML, Claude Opus 4.6 et sa version Thinking occupent là encore les deux premières places, mais Google parvient à se glisser sur le podium. Gemini 3.1 Pro Preview décroche en effet la 3e position avec un score Elo de 1522, son meilleur résultat toutes catégories confondues. GPT-5.2 High se maintient à la 6e place, tandis que Z.ai place deux modèles dans le top 10 (GLM-4.7 et GLM-5).

En React, la domination d’Anthropic est encore plus nette : les cinq premières places sont occupées par des modèles Claude. OpenAI disparaît totalement du top 10, laissant les places restantes à Z.ai (GLM-5 et GLM-4.7), Google (Gemini 3.1 Pro Preview et Gemini 3 Flash) et Moonshot AI (Kimi-k2.5 Thinking).

Les critères de classement de la WebDev Arena

Le classement de la WebDev Arena repose sur un principe de comparaison en aveugle. Deux modèles d’IA reçoivent la même instruction et produisent chacun une réponse. Les utilisateurs évaluent ensuite les résultats sans connaître l’identité des modèles, puis désignent la proposition qu’ils jugent la plus aboutie. Ces votes alimentent un score Elo, un système emprunté au monde des échecs : battre un modèle bien classé rapporte davantage de points, tandis qu’une défaite face à un concurrent moins bien placé entraîne une pénalité plus lourde. Le classement est mis à jour en continu au fil des votes.