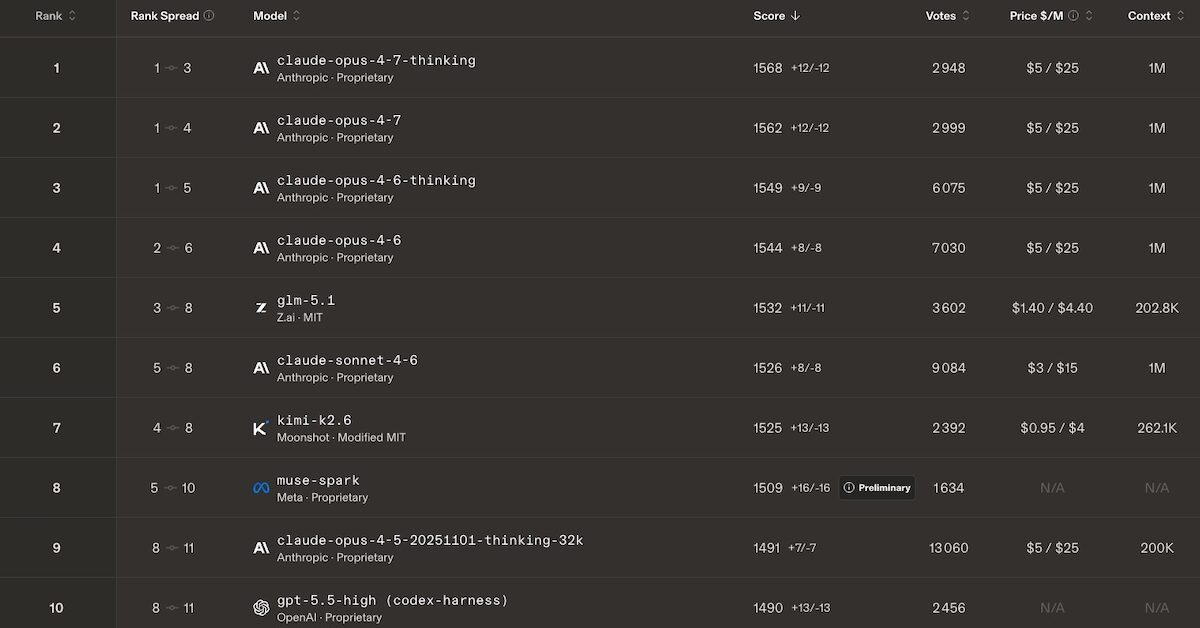

Les mois se suivent et se ressemblent pour Anthropic, qui continue de dominer sans partage la WebDevArena, le classement de LMArena mesurant les performances des modèles d’IA « sur les tâches de développement web front-end, y compris les workflows de codage agentique nécessitant un raisonnement en plusieurs étapes et l’utilisation d’outils ». En mai 2026, la firme américaine place six de ses modèles dans le top 10. Elle truste, surtout, quatre des cinq premières positions grâce aux itérations de Claude Opus 4.6 et 4.7.

Anthropic intouchable, Google décroché

Déployés sur Claude le 16 avril dernier, les versions standard et « thinking » de Claude Opus 4.7 succèdent assez logiquement à leurs prédécesseures aux deux premières positions du classement. Un lancement qui a également pour effet d’éjecter GLM-5.1 du podium. Développé par l’entreprise chinoise Z.ai, GLM-5.1 avait réussi une performance assez remarquable en avril : devenir le premier modèle open source à atteindre le podium de la WebDevArena.

Derrière, on note la disparition de Gemini 3.1 Pro de la première partie du tableau. C’est un petit événement pour Google qui, sans dominer outrageusement ce classement, en occupait régulièrement les places d’honneur aux côtés d’OpenAI. La firme de Sam Altman, quant à elle, continue également de reculer, et ne pointe plus qu’à la dixième position avec la version « high » de GPT-5.5, qui alimente notamment Codex. Elle se retrouve désormais devancée par Meta qui, avec Muse Spark, fait une entrée remarquée dans ce classement directement en huitième position.

Voici les 10 modèles d’IA les plus performants pour le code et le développement web en mai 2026 :

- Claude Opus 4.7 Thinking (Anthropic) : 1 568 (score Elo)

- Claude Opus 4.7 (Anthropic) : 1 562

- Claude Opus 4.6 (Anthropic) : 1 549

- Claude Opus 4.6 (Anthropic) : 1 544

- GLM-5.1 (Z.ai) : 1 532

- Claude Sonnet 4.6 (Anthropic) : 1 526

- Kimi-k2.6 (Moonshot) : 1 525

- Muse Spark (Meta) : 1 509

- Claude Opus 4.5 (Anthropic) : 1 491

- GPT-5.5 High (OpenAI) : 1 490

Comment la WebDevArena classe-t-elle les modèles d’IA dédiés au développement web ?

La WebDevArena, comme les autres classements établis par LMArena (ex-Chatbot Arena), repose sur un principe de duels. À l’aveugle, les utilisateurs de la plateforme départagent deux modèles ayant répondu à une même requête. Comme aux échecs ou en esport, chaque modèle dispose d’un score Elo, qui évolue au fil de ces rencontres et en temps réel. Battre un modèle mieux classé rapporte de l’Elo, tandis que perdre face à un modèle moins bien classé pénalise le score. Un modèle en tête peut néanmoins continuer de progresser en remportant des duels contre des adversaires théoriquement plus faibles que lui, mais son score évolue plus lentement.