Le classement de la WebDev Arena continue d’évoluer au rythme des sorties de modèles. En ce mois d’avril 2026, la principale nouveauté vient de Z.ai, avec son modèle GLM-5.1, lancé le 7 avril, qui s’immisce directement sur le podium du classement général, brisant la domination exclusive d’Anthropic sur les trois premières places. Tour d’horizon des mouvements du mois.

Anthropic frôle le carton plein, mais Z.ai s’invite sur le podium

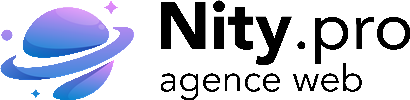

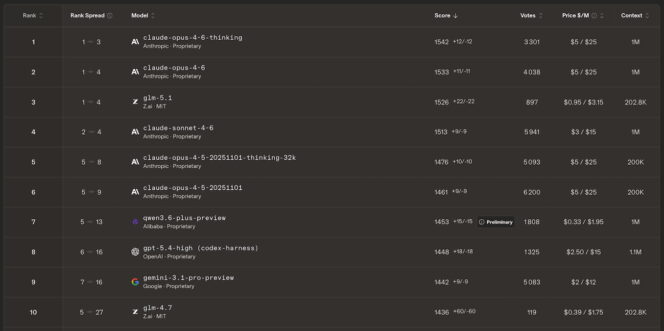

Anthropic conserve une emprise considérable sur le secteur du développement assisté par IA. Cinq des six premières places du classement général de la WebDev Arena sont occupées par des modèles Claude : Opus 4.6 Thinking prend la tête, devant Opus 4.6, Sonnet 4.6 (4e), et les deux déclinaisons d’Opus 4.5 (5e et 6e). Seul intrus dans au sein du groupe de tête, GLM-5.1 de Z.ai, qui s’intercale à la 3e place.

C’est la première fois qu’un modèle open source (licence MIT) atteint le podium de la WebDev Arena. GLM-5.1, lancé le 7 avril par Z.ai (anciennement Zhipu AI, spin-off de l’université Tsinghua), est une évolution du GLM-5 qui figurait déjà à la 8e place en mars. Autre mouvement en tête de classement : Claude Opus 4.6 Thinking passe devant sa version standard, inversant l’ordre observé le mois dernier.

Côté OpenAI, le renouvellement générationnel se poursuit. GPT-5.4 High, dans sa déclinaison « codex-harness », fait son entrée à la 7e place, remplaçant GPT-5.2 High qui sort du top 10. Google maintient Gemini 3.1 Pro Preview à la 8e position, mais perd ses deux modèles Gemini 3 Pro et Gemini 3 Flash, qui quittent le top 10. Alibaba fait quant à lui une apparition avec Qwen3.6-plus-preview, directement 9e (score encore préliminaire), tandis que Z.ai double sa présence avec GLM-4.7 en 10e position.

Les 10 modèles d’IA les plus performants pour le code et le développement web en avril 2026 :

- Claude Opus 4.6 Thinking : 1548 (score Elo)

- Claude Opus 4.6 : 1542

- GLM-5.1 (Z.ai) : 1530

- Claude Sonnet 4.6 : 1521

- Claude Opus 4.5 Thinking : 1490

- Claude Opus 4.5 : 1466

- GPT-5.4 High : 1457

- Gemini 3.1 Pro Preview : 1456

- Qwen3.6-plus-preview (Alibaba) : 1453

- GLM-4.7 (Z.ai) : 1439

Découvrir le classement complet

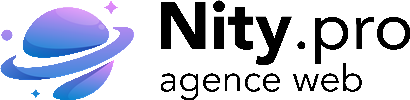

Les classements HTML et React confirment la percée de Z.ai

En HTML, Anthropic conserve les trois premières places (Opus 4.6, Opus 4.6 Thinking, Sonnet 4.6), mais GLM-5.1 se positionne immédiatement derrière, à la 4e place. Google se distingue avec Gemini 3.1 Pro Preview en 6e position, son meilleur résultat toutes catégories confondues. OpenAI fait entrer deux variantes de GPT-5.4 dans le top 10 : GPT-5.4 Medium en 7e place et GPT-5.4 High en 10e.

En React, GLM-5.1 confirme sa percée avec une 3e place, intercalé entre Claude Opus 4.6 et Claude Sonnet 4.6. Alibaba fait irruption dans le top 10 avec Qwen3.6-plus-preview à la 7e place, devant GPT-5.4 High (8e). Z.ai place trois modèles dans les 12 premières positions (GLM-5.1, GLM-4.7 et GLM-5), confirmant sa montée en puissance dans l’écosystème du développement web assisté par IA.

Les critères de classement de la WebDev Arena

La WebDev Arena fonctionne sur le principe du vote à l’aveugle. Face à une même consigne, deux modèles génèrent chacun une réponse. Les internautes comparent les résultats sans savoir quel modèle se cache derrière chaque proposition, puis votent pour celle qu’ils estiment la plus réussie. Les résultats sont ensuite convertis en score Elo, un système de classement issu des échecs et utilisé dans l’esport : une victoire contre un adversaire mieux classé rapporte plus de points, une défaite face à un modèle moins bien placé en fait perdre davantage. Le classement évolue en continu, au rythme des votes.